Saya merangkum kerangka statistik praktis untuk membaca data keluaran HK tanpa basa-basi. Fokusnya: apa yang bisa diukur, bagaimana mengukur dengan benar, dan cara menghindari bias umum agar keputusan Anda tetap rasional.

1) Memahami Data Keluaran

-

Unit Analisis: baris hasil per tanggal/putaran.

-

Variabel Minimal: tanggal, angka pemenang (n-digit), sumber data.

-

Kebersihan Data: cek duplikasi, format tanggal konsisten (ISO 8601), whitespace, dan pengkodean.

-

Jendela Waktu: tentukan horizon analisis (mis. 30, 90, 365 hari) agar metrik tidak menipu.

> Catatan internal: tanpa data bersih, semua metrik berikutnya rapuh.

2) Metrik Dasar yang Benar-Benar Berguna

-

Frekuensi Angka: proporsi kemunculan setiap digit/angka.

-

Distribusi Posisi: untuk angka multi-digit, cek setiap posisi (mis. ribuan, ratusan) secara terpisah.

-

Kesenjangan (Gap) Kemunculan: jarak antar kemunculan angka tertentu; ringkas dengan median dan IQR.

-

Run Length & Alternation: panjang rentetan pola (genap/ganjil, besar/kecil); berguna untuk sanity-check acak.

-

Entropi Shannon: ringkas keragaman; entropi tinggi ≈ lebih acak.

-

Autokorelasi (lag 1–7): uji pola serial sederhana. Harus mendekati nol pada proses acak.

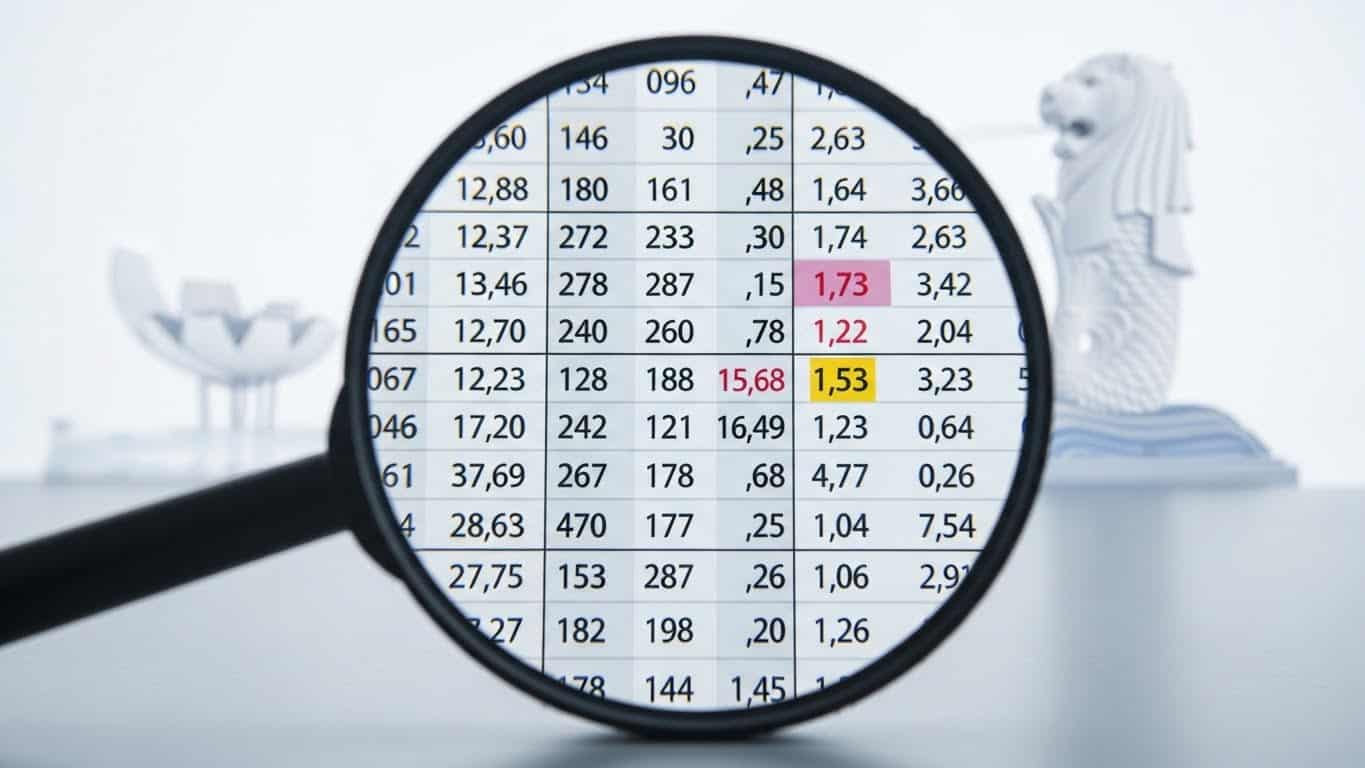

3) Visual Sederhana yang Cukup

-

Histogram Frekuensi: bandingkan proporsi aktual vs harapan seragam.

-

Plot Heatmap Posisi x Angka: menilai bias per posisi.

-

QQ Plot: untuk skor transformasi ke uniform; deviasi = potensi bias.

-

ACF Plot: lihat korelasi serial hingga 7–14 lag.

4) Uji Statistik Tanpa Keribetan

-

Uji Chi-Kuadrat Kesesuaian: frekuensi angka vs distribusi seragam.

-

Uji Runs: acak vs pola untuk binerisasi (genap/ganjil, di atas/bawah median).

-

Ljung–Box: uji keseluruhan autokorelasi.

-

Benford (opsional): hanya relevan untuk leading digit pada dataset non-loteri; jangan dipaksakan.

Interpretasi: gunakan p-value sebagai sinyal, bukan vonis. Terapkan koreksi multipel (Bonferroni/BH) jika menguji banyak hipotesis.

5) Praktik Baik agar Tidak Tersesat

-

Pre-registrasi Hipotesis: tulis dulu apa yang ingin diuji untuk menghindari p-hacking.

-

Holdout/Backtest: pisahkan data latih vs uji berdasarkan waktu.

-

Data Leakage: hindari fitur yang “mengintip masa depan”.

-

Robustness Checks: ubah jendela waktu, granularitas, atau metode—lihat apakah kesimpulan stabil.

6) Contoh Alur Analisis (Pythonic)

import pandas as pd

import numpy as np

from scipy import stats

# 1) Load & clean

df = (pd.read_csv('hk.csv', parse_dates=['tanggal'])

.drop_duplicates()

.sort_values('tanggal')

.assign(angka=lambda d: d['angka'].astype(str).str.zfill(4)))

# 2) Frequency per digit

freq = (pd.Series(list(''.join(df['angka'])))

.value_counts(normalize=True).sort_index())

# 3) Positional heatmap frame

pos = pd.DataFrame({i: df['angka'].str[i] for i in range(4)}).apply(pd.value_counts)

pos = pos.div(pos.sum())

# 4) Runs test (even/odd)

parity = df['angka'].astype(int) % 2

# implement runs test atau gunakan statsmodels

# 5) Chi-square vs uniform (0–9)

obs = (freq * len(freq)).values

exp = np.full_like(obs, fill_value=obs.mean())

chi = stats.chisquare(obs, f_exp=exp)

> Ingat: contoh kode bertujuan memberi kerangka, bukan orakel akal sehat.

7) Mitos Umum yang Perlu Dibuang

-

“Angka yang lama tidak keluar jadi ‘jatuh tempo’.” Salah. Proses acak tidak punya ingatan.

-

“Pola visual pasti berarti peluang berubah.” Hati-hati dengan apofenia; verifikasi dengan uji formal.

-

“Satu metrik cukup untuk simpulkan bias.” Selalu cek lintas-metrik dan lakukan validasi waktu.

8) Etika dan Legalitas

-

Pastikan sumber data sah dan menghormati ketentuan penggunaan.

-

Hindari klaim performa yang menyesatkan; tekankan ketidakpastian.

-

Jangan mengotomasi tindakan yang melanggar hukum atau kebijakan platform.

9) Checklist No-Nonsense

-

Data bersih, rentang waktu jelas, metrik inti dihitung.

-

Visual yang padat makna, bukan hiasan.

-

Uji yang relevan, koreksi multipel diterapkan.

-

Validasi waktu dan robustness check lulus.

-

Dokumentasi pendek, reprodusibel, dan jujur.

Penutup

Saya sengaja menyederhanakan tanpa mengorbankan ketelitian. Kalau Anda butuh template notebook, format dashboard, atau pipeline otomatis untuk dataset spesifik Anda, beri tahu saya — saya akan siapkan kerangka yang plug-and-play.